Assurer la Haute Disponibilité pour Éviter les Risques de Pannes d’Applications

Dans le paysage numérique actuel, les applications sont au cœur des activités des entreprises. Les utilisateurs attendent un accès permanent, 24 heures sur 24, 7 jours sur 7. Ainsi, fournir une infrastructure IT performante, sécurisée et disponible est devenu essentiel pour toutes les organisations, quelle que soit leur taille.

Les conséquences graves des interruptions non planifiées

Les pannes d’application peuvent découler de diverses causes : défaillances matérielles, erreurs logicielles, maladresses humaines ou cyberattaques. Dans tous les cas, les impacts sur l’entreprise sont importants :

- Perte de productivité : lorsque les applications sont hors service, le travail des équipes est perturbé, voire paralysé dans certains secteurs comme l’industrie. Les coûts liés au redémarrage et à la reprise des opérations peuvent être très élevés.

- Atteinte à la réputation : une expérience utilisateur dégradée pousse les clients à chercher des alternatives. Si une cyberattaque entraîne une fuite de données, les dégâts réputationnels peuvent être sévères.

- Chute du chiffre d’affaires : les temps de chargement trop longs ou les pannes font fuir les clients. Par exemple, 50 % des consommateurs abandonnent leur panier si une page web met plus de six secondes à s’afficher.

- Opportunités manquées : un service défaillant fait fuir aussi bien les clients potentiels que les partenaires B2B, compromettant ainsi la croissance commerciale.

- Coûts cachés : la mobilisation des équipes IT pour résoudre l’urgence peut retarder d’autres projets importants, engendrant des frais supplémentaires, parfois très conséquents pour les grandes entreprises.

Comment garantir la haute disponibilité ?

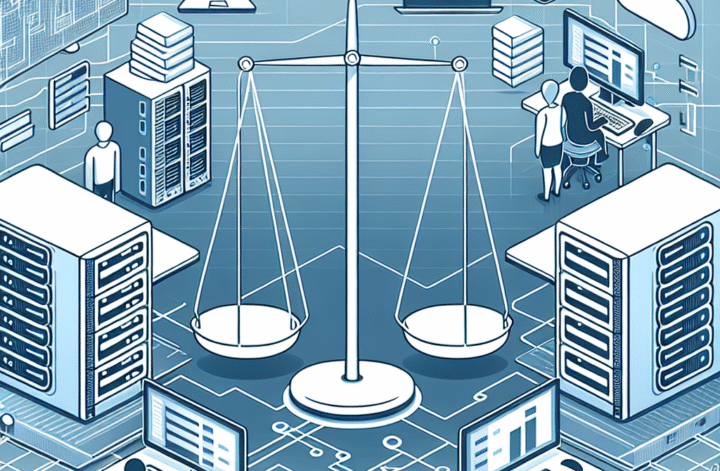

Pour faire face à ces défis, les load balancers (répartiteurs de charge) sont devenus indispensables. Ces dispositifs, matériels ou logiciels, se placent entre les utilisateurs et les serveurs d’applications pour distribuer intelligemment les requêtes.

Ils fonctionnent comme un proxy inverse, utilisant une adresse IP virtuelle pour faire croire au client qu’il interagit avec un seul serveur, alors que la charge est répartie sur plusieurs machines.

Cette répartition optimise la performance, évite les surcharges et améliore la résilience du service. Lorsque l’une des instances serveur ne répond plus, le load balancer l’exclut automatiquement du pool jusqu’à ce qu’elle redevienne opérationnelle.

Les avantages supplémentaires des load balancers

Au-delà de la disponibilité et de la scalabilité, ces outils peuvent renforcer la sécurité. Ils intègrent souvent des fonctions avancées comme les pare-feu applicatifs web (WAF) ou l’authentification renforcée à deux facteurs (2FA), contribuant à prévenir les cybermenaces.

Pour un niveau supérieur de protection et de continuité, la mise en place de la Global Server Load Balancing (GSLB) permet de répartir le trafic sur plusieurs centres de données situés dans différentes régions géographiques, limitant ainsi l’impact d’une catastrophe locale.

Une solution adaptable aux environnements modernes

Avec la montée en puissance des environnements multi-cloud, il est crucial que la solution de répartition de charge soit flexible, sécurisée et économique, capable de s’adapter aux infrastructures cloud tout en intégrant les ressources sur site existantes.

En adoptant cette approche stratégique, les entreprises peuvent considérablement réduire les risques liés aux pannes imprévues, sécuriser leurs données, et offrir une expérience utilisateur optimale, indispensable pour rester compétitives.

👉 Source ici