Le Massachusetts Institute of Technology (MIT) innove dans le domaine de la robotique avec un système capable d’aider les humains de manière autonome, intelligente et sécurisée, en se concentrant sur les objets les plus pertinents dans un environnement donné. Cette avancée repose sur une approche baptisée « Relevance » (Pertinence), permettant au robot de comprendre rapidement les objectifs humains à partir d’indices visuels et sonores, afin de sélectionner les éléments essentiels pour répondre à leurs besoins.

**Un système inspiré du cerveau humain**

L’équipe du MIT s’est inspirée du fonctionnement du cerveau humain, en particulier du système d’activation réticulaire (SAR), une structure neuronale qui filtre en permanence les stimuli pour ne laisser passer que les informations pertinentes. Cette capacité à éviter la surcharge sensorielle est capitale pour focaliser l’attention sur l’essentiel, comme par exemple cibler une action spécifique au lieu de considérer chaque détail autour de soi.

Le robot intègre cette fonction grâce à un système d’IA multifacette : un grand modèle de langage analyse les conversations pour détecter des mots-clés, tandis que d’autres algorithmes identifient et classifient les objets, les actions humaines et les objectifs en temps réel. Ce travail de filtrage s’effectue continuellement en arrière-plan, mimant ainsi la vigilance subconsciente du cerveau.

**Quatre phases pour une assistance efficace**

La méthode se décompose en quatre étapes :

1. La phase de perception où le robot collecte et analyse les indices audio-visuels.

2. Une vérification régulière détectant la présence humaine.

3. Le cœur du dispositif, la phase d’évaluation de la pertinence, qui identifie les classes et éléments les plus liés à l’objectif humain (par exemple, choisir uniquement les tasses et crèmes pour un objectif de préparer un café).

4. Enfin, le robot planifie son déplacement pour atteindre et proposer ces objets à l’utilisateur.

**Des résultats prometteurs**

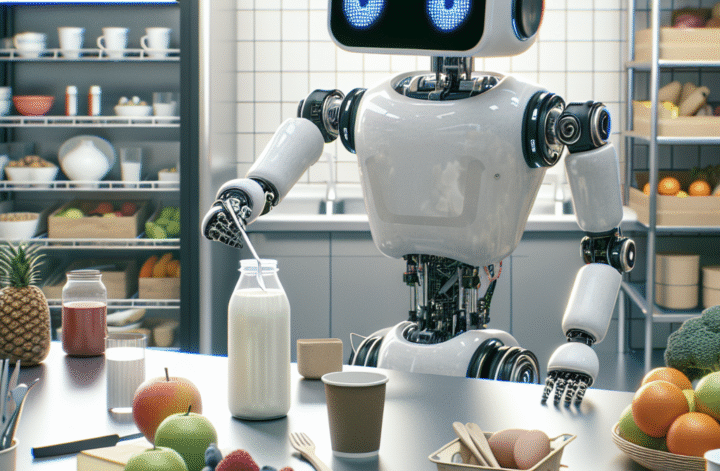

Pour démontrer l’efficacité de leur système, les chercheurs ont simulé une scène de petit-déjeuner à une conférence avec une table garnie de fruits, boissons, encas et ustensiles. Le robot, équipé d’un bras mécanique, d’un microphone et d’une caméra, a montré sa capacité à anticiper les besoins humains avec 90% d’exactitude dans la prédiction des objectifs, et 96% de précision dans l’identification des objets utiles.

En situations concrètes, il a su par exemple détecter qu’une personne s’apprêtait à préparer un café et lui tendre rapidement le lait et la cuillère nécessaires. Mieux encore, il a réduit les collisions et incidents d’environ 60%, optimisant ainsi la sécurité lors de l’interaction.

**Vers une collaboration homme-robot fluide**

Selon Kamal Youcef-Toumi, professeur au MIT, cette capacité à extraire automatiquement la pertinence de la scène évite au robot de poser de multiples questions, rendant l’interaction plus naturelle et intuitive. Les recherches se poursuivent pour étendre ces applications aux environnements industriels et logistiques où robots et humains travaillent côte à côte.

Les travaux seront présentés à la conférence IEEE International Conference on Robotics and Automation (ICRA) en mai 2025 et ouvrent des perspectives très encourageantes pour la collaboration homme-machine du futur.

👉 Source ici